Configuration du fichier Robots.txt

Le fichier robots.txt indique aux moteurs de recherche et aux autres robots d'indexation quelles pages de votre site ils sont autorisés à explorer. Il s'agit d'un simple fichier texte situé à la racine de votre domaine qui suit la spécification standard du fichier robots.txt.

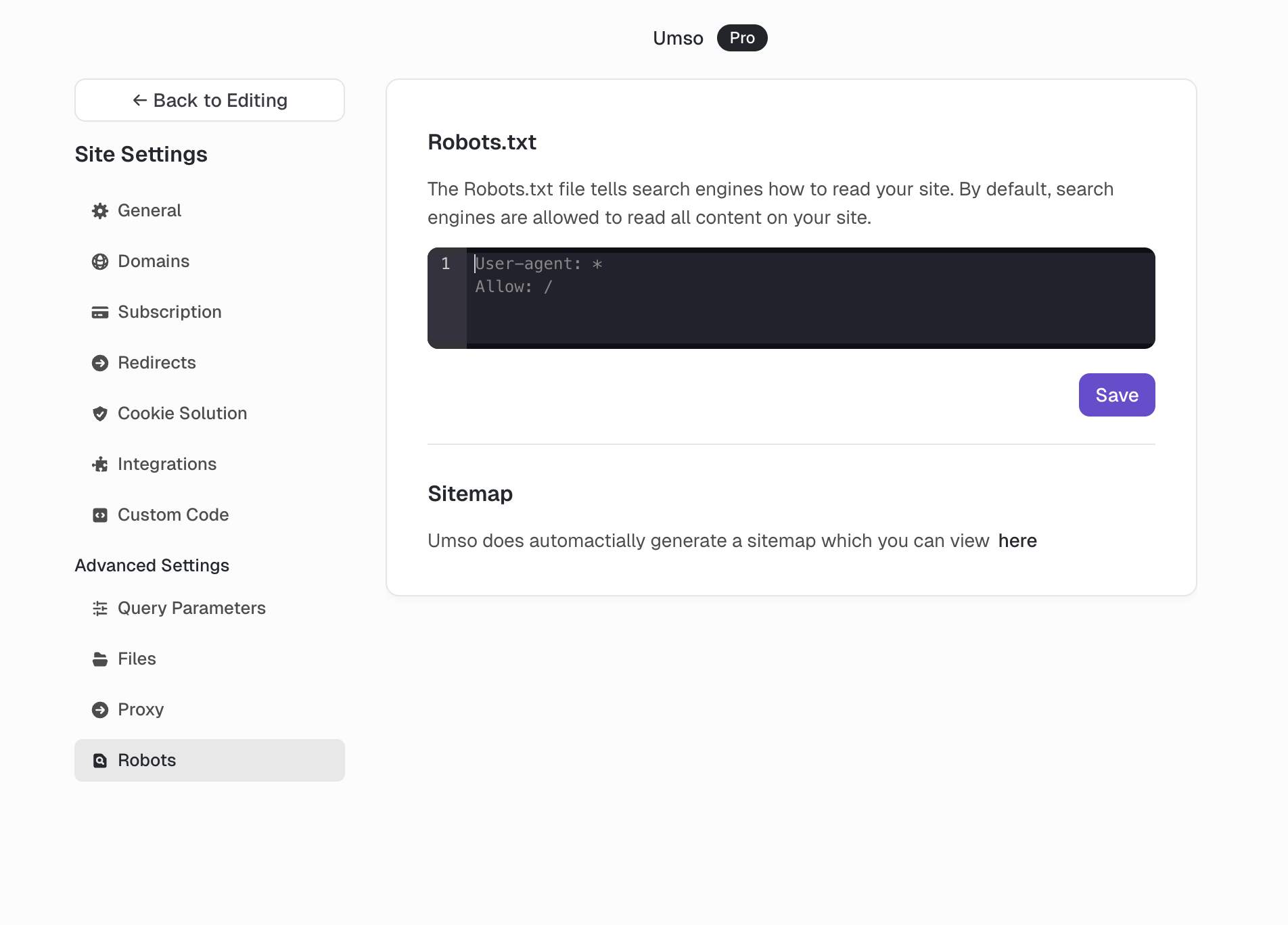

Accéder au fichier Robots.txt dans Umso

Pour modifier le fichier robots.txt de votre site :

Ouvrez votre site dans l'éditeur

Cliquez sur Site Settings dans la barre latérale

Accédez à Advanced Settings

Sélectionnez Robots

Modifiez le contenu du robots.txt dans l'éditeur de code

Cliquez sur Save

Par défaut, Umso autorise tous les robots à accéder à toutes les pages :

User-agent: *

Allow: /Exemples courants

Bloquer toutes les pages pour Google

Empêcher Google d'explorer n'importe quelle page de votre site. Utile pour les sites de test ou lorsque vous souhaitez que l'intégralité de votre site ne figure pas dans les résultats de recherche.

User-agent: Googlebot

Disallow: /Bloquer une page spécifique

Empêcher les robots d'accéder à une seule page, telle qu'une page de remerciement, une zone d'administration ou une page de destination privée.

User-agent: *

Disallow: /thank-youBloquer plusieurs pages

Empêcher les robots d'accéder à plusieurs pages spécifiques en listant chaque chemin sur sa propre ligne.

User-agent: *

Disallow: /admin

Disallow: /login

Disallow: /dashboardBloquer un répertoire

Empêcher les robots d'accéder à toutes les pages d'un répertoire spécifique.

User-agent: *

Disallow: /private/Bloquer les robots d'IA

Empêcher ChatGPT et d'autres robots d'entraînement d'IA d'utiliser le contenu de votre site. Notez que tous les robots d'IA ne respectent pas le fichier robots.txt et que de nouveaux robots apparaissent régulièrement.

# Block ChatGPT / OpenAI

User-agent: GPTBot

Disallow: /

# Block Common Crawl (used for AI training)

User-agent: CCBot

Disallow: /

# Block Google AI training

User-agent: Google-Extended

Disallow: /

# Block Anthropic

User-agent: Claude-Web

Disallow: /

User-agent: anthropic-ai

Disallow: /

# Block other common AI crawlers

User-agent: FacebookBot

Disallow: /

User-agent: bytespider

Disallow: /Considérations importantes

Le fichier Robots.txt est une directive, pas une garantie. La plupart des robots légitimes le respectent, mais les robots malveillants peuvent l'ignorer totalement.

Il ne masque pas les pages. Les pages bloquées par le fichier robots.txt peuvent toujours apparaître dans les résultats de recherche si d'autres sites pointent vers elles. Pour empêcher totalement l'indexation, utilisez plutôt la balise méta de blocage d'indexation à la place.

Les changements prennent du temps. Les moteurs de recherche peuvent mettre en cache votre fichier robots.txt, de sorte que les modifications peuvent mettre plusieurs jours ou semaines à prendre effet.

Testez vos règles. Utilisez l'outil de test du fichier robots.txt de la Google Search Console pour vérifier que vos règles fonctionnent comme prévu avant de publier.

Articles connexes

Umso génère automatiquement un sitemap pour votre site, ce qui aide les moteurs de recherche à découvrir vos pages. Pour le contenu protégé par mot de passe, vous pouvez également utiliser des mots de passe de site et de page en complément des règles du fichier robots.txt.